Risiken im Recruiting: So verhinderst du Datenlecks durch KI

Die schnelle Entwicklung von KI-Technologien wie ChatGPT bietet Unternehmen – auch in der Recruiting-Branche – enorme Möglichkeiten, Prozesse zu beschleunigen und effizienter zu gestalten. Ob Kundenservice oder automatisierte Berichterstattung – KI übernimmt eine immer größere Rolle bei der Optimierung von Geschäftsabläufen.

Doch mit diesen Vorteilen gehen auch neue Risiken einher, vor allem wenn sensible Informationen versehentlich über KI-Systeme weitergegeben werden. Wie auf datenschutzundgesundheit.de berichtet wird, birgt die Nutzung von ChatGPT in medizinischen Einrichtungen erhebliche datenschutzrechtliche Gefahren. So kann schon die Eingabe von Gesundheitsdaten durch Praxispersonal in ein KI-System wie ChatGPT gegen geltendes Datenschutzrecht verstoßen. Diese Problematik zeigt deutlich: Es fehlt oft an Bewusstsein für die Risiken im Umgang mit KI. Und diese Entwicklung wirft wichtige Fragen auf: Wie gehen wir im Recruiting mit Daten und Datenschutz um? Und wie lassen sich Datenlecks durch KI vermeiden?

Jedes Unternehmen möchte ein Datenleck im Zusammenhang mit KI vermeiden. In diesem Beitrag erfährst du mehr über die Risiken und bekommst konkrete Tipps.

KI und Datenlecks: eine wachsende Herausforderung

Die Risiken sind real. Wenn Unternehmensdaten, Kundeninformationen oder andere sensible Inhalte über KI-Systeme geteilt werden, können sie außerhalb der geschützten Umgebung deines Unternehmens landen. Der Grund: KI-Modelle wie ChatGPT werden mit riesigen Datenmengen trainiert. Auch wenn sie deine Eingaben nicht direkt speichern, können Spuren vertraulicher Informationen in den Algorithmen zurückbleiben. Diese Informationen könnten dann – unbeabsichtigt – in künftigen Antworten wieder auftauchen.

Laut Gartner werden in 2027 werden rund 40 % aller Datenschutzverletzungen auf die missbräuchliche Nutzung generativer KI und grenzüberschreitender Datenflüsse zurückzuführen sein Umso wichtiger ist es, frühzeitig vorbeugende Maßnahmen zu treffen. Bewusstsein für diese Risiken ist der erste Schritt zu einem sicheren Umgang mit KI.

Die Rolle von Bewusstsein und Regulierung

Bastiaan Brans, Datenschutzbeauftragter bei OTYS, betont, wie wichtig ein bewusster Umgang mit Daten ist. Gerade im Recruiting, wo tagtäglich mit Lebensläufen, Gehaltswünschen oder Gesprächsnotizen gearbeitet wird, ist ein sensibler Umgang mit personenbezogenen Daten entscheidend:

„Nichts ist umsonst. Wenn du nicht mit Geld bezahlst, dann mit Daten. Google hat 2005 eine der damals besten Webanalyse-Tools übernommen, deutlich verbessert und dann kostenlos als Google Analytics angeboten. Risiken gibt es immer – man sollte sie minimieren. Wenn du Daten an ein KI-System übermittelst, dann bitte über europäische Server.“

Wie Bastiaan erklärt, denken viele Menschen gar nicht über Risiken nach. „Ein Beispiel ist Suno, ein Tool für KI-generierte Songs. Man kann dort scheinbar harmlos emotionale oder persönliche Inhalte eingeben – doch was mit diesen Informationen geschieht, bleibt unklar.“ Als Recruiter*in solltest du also keinesfalls ungeprüft Informationen über Kandidat*innen in ChatGPT eingeben – du weißt nie, was danach damit passiert.

Auch gesetzlich ist die Lage eindeutig: Die DSGVO (Datenschutz-Grundverordnung) schreibt klar vor, dass Unternehmen die Sicherheit personenbezogener Daten gewährleisten müssen – ganz gleich, welche Technologien eingesetzt werden. Die Verantwortung liegt also beim Unternehmen, dafür zu sorgen, dass KI-Systeme sicher genutzt und vertrauliche Daten nicht unkontrolliert geteilt werden.

Wie sich OTYS dieser Herausforderung stellt und Datenlecks durch KI verhindert

Bei OTYS sind wir uns der Risiken bewusst – und nehmen sie sehr ernst. Deshalb setzen wir nicht nur auf technische Sicherheitsmaßnahmen, sondern legen auch großen Wert auf die Sensibilisierung unserer Nutzer*innen.

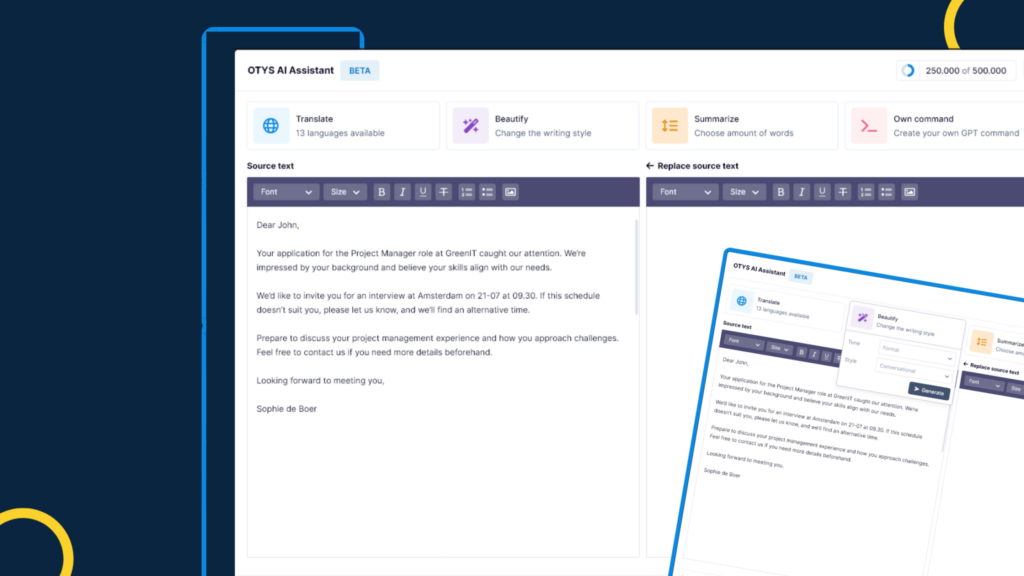

Bastiaan Brans erklärt, wie wir dieses Thema angehen: „Schulungen, Wiederholungen, regelmäßige Hinweise – wir machen alles, was zur Sensibilisierung gehört. Aber was noch wichtiger ist es, den Menschen eine echte Alternative zu bieten. Viele wissen zum Beispiel, dass ein Flug nach Bali schlecht fürs Klima ist – aber es gibt kaum echte Alternativen, wenn man wirklich nach Bali möchte. Bewusstseinsbildung ist also der erste Schritt - aber ChatGPT einfach zu verbieten, wird nicht funktionieren. Unser OTYS AI Assistant ist eine sinnvolle Alternative zu ChatGPT – speziell für Recruiter*innen, die effizient arbeiten möchten, ohne Risiken beim Datenschutz einzugehen.“

OTYS arbeitet laufend an der Weiterentwicklung seiner Systeme, um Kund*innen bestmöglich vor Risiken zu schützen – von Echtzeitüberwachung bis hin zu sicherer Datenspeicherung. Wer Datenlecks durch KI im Recruiting verhindern will, trifft mit dem OTYS AI Assistant eine kluge Entscheidung.

Innovationen für die Zukunft

Unser Blick richtet sich nicht nur auf das Heute, sondern auch auf morgen. Aktuell entwickeln wir neue Lösungen – darunter moderne Verschlüsselungstechniken und KI-gestützte Tools, die Unternehmen aktiv beim Schutz vor Datenlecks unterstützen.

Fazit

Das unbeabsichtigte Teilen sensibler Informationen über KI-Systeme wie ChatGPT ist ein wachsendes Problem, das Unternehmen weltweit betrifft. Bei OTYS nehmen wir diese Herausforderung sehr ernst. Mit innovativen Lösungen und klarem Fokus auf Datensicherheit sorgen wir dafür, dass sensible Recruiting-Daten – von Kandidatenprofilen bis hin zu vertraulichen E-Mails – heute und in Zukunft geschützt sind.